X bloque les recherches sur Taylor Swift à cause de ses (fausses) photos de nu

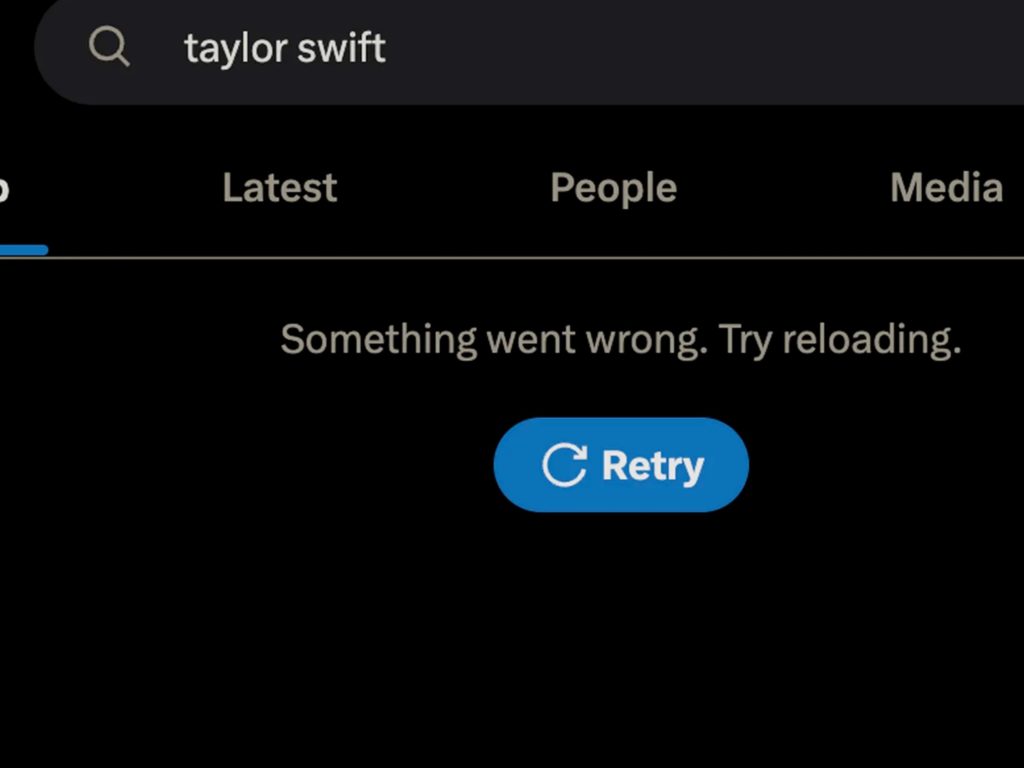

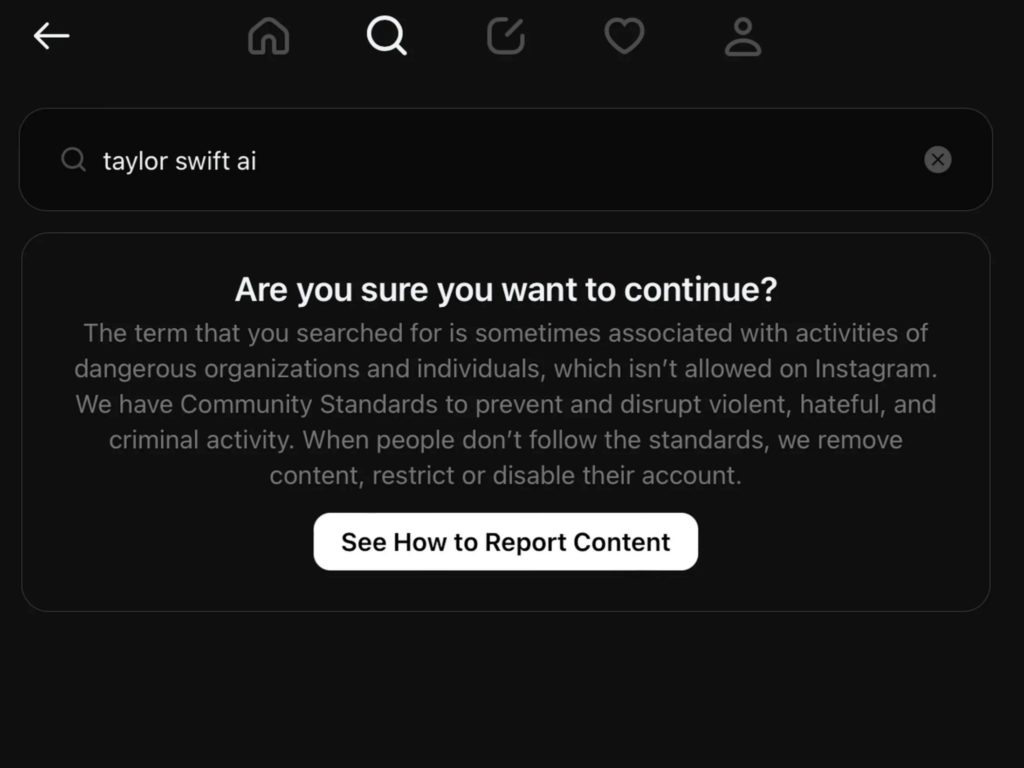

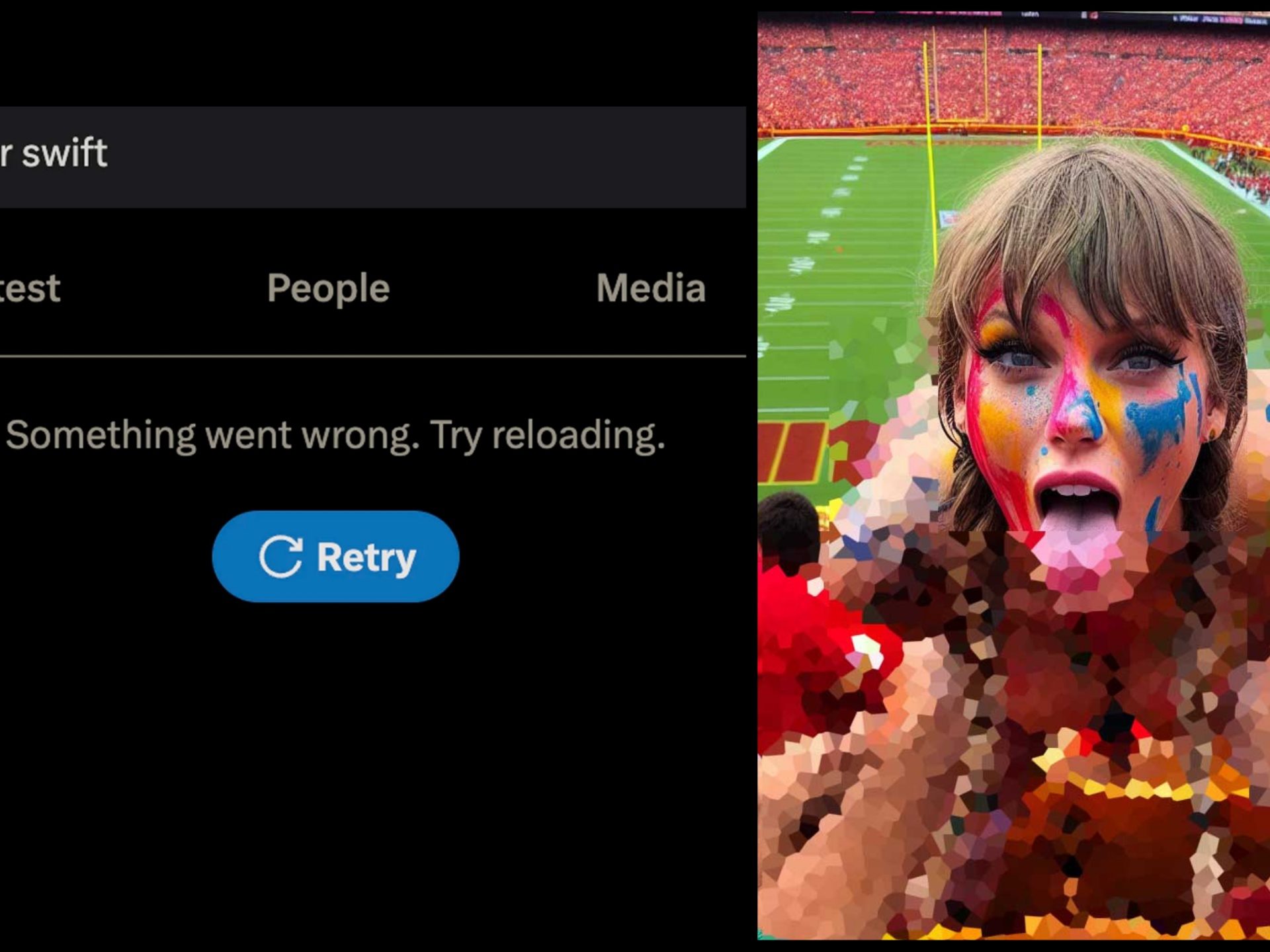

À ces heures-là, Taylor Swift est introuvable sur X (anciennement Twitter) : le réseau social bloque les recherches sans donner d'explications. Et l'explication se trouve dans les photos nues de Taylor sans donner d'explications. Mais il y a une explication. C'est la réaction de X face à l'essor des recherches après la publication de photos sexuellement explicites du chanteur créées avec l'intelligence artificielle. À l'heure actuelle, si vous recherchez « Taylor Swift » ou « Taylor Swift AI » sur X, vous pouvez voir le message « Quelque chose s'est mal passé ». X a tenté de bloquer les recherches individuelles de photos deepfake, mais a probablement dû faire un choix plus drastique pour des raisons de timing.

LIRE AUSSI

- Taylor Swift dépouillée de l'IA, se révolte sur les réseaux sociaux

- Selena Gomez révèle ce qu'elle a laissé échapper à l'oreille de Taylor Swift aux Globes

- Taylor Swift teasée par l'animateur aux Golden Globes : carrière terminée pour lui

- Taylor Swift dans le rôle de « Barbie » : talon cassé et elle reste sur la pointe des pieds

X bloque les recherches de Taylor Swift mais il existe un moyen de contourner ce problème

Mais il suffit d’un petit effort pour contourner le pâté de maisons. "Taylor AI Swift" ou simplement mettre son nom entre guillemets ont tous deux renvoyé des résultats au moment d'écrire ces lignes. Même l'ajout d'un autre mot à l'un des termes de recherche apparemment bloqués donne des résultats. De plus, les images apparaissent toujours dans l'onglet Média.

X a publié une déclaration près d'un jour après la publication des images, affirmant qu'il « supprimait activement toutes les images identifiées » et prenait des mesures contre les comptes les publiant. Le site interdit explicitement la nudité non consensuelle et les médias synthétiques et manipulés.

Taylor Swift envisage une action en justice

Les médias rapportent que Swift envisage d'intenter une action en justice contre les sites hébergeant des images créées avec Microsoft Designer. Le PDG de Microsoft, Satya Nadella, a qualifié les deepfakes d'« alarmants et terribles » dans une interview avec NBC Nightly News, et a déclaré qu'il pensait que les entreprises d'IA devaient « agir rapidement » pour mettre en place de meilleurs systèmes de sécurité.

LIRE PLUS D'ACTUALITÉS DE DIVERTISSEMENT

- Grammy Awards 2026 : Latex et robes vaporeuses : Les looks les plus scandaleux d’Heidi Klum et Chappell Roan

- Marvel pleure la disparition du légendaire acteur vocal de Spider-Man

- Charli XCX brave le froid à Sundance : un shooting lingerie par des températures négatives

- L'acteur Quinton Aaron est dans un état critique après un grave accident domestique.

- La fille cachée de Freddie Mercury décède à 48 ans

Suivez-nous également sur Google News : Cliquez ici