Taylor Swift dépouillée de l'IA, se révolte sur les réseaux sociaux

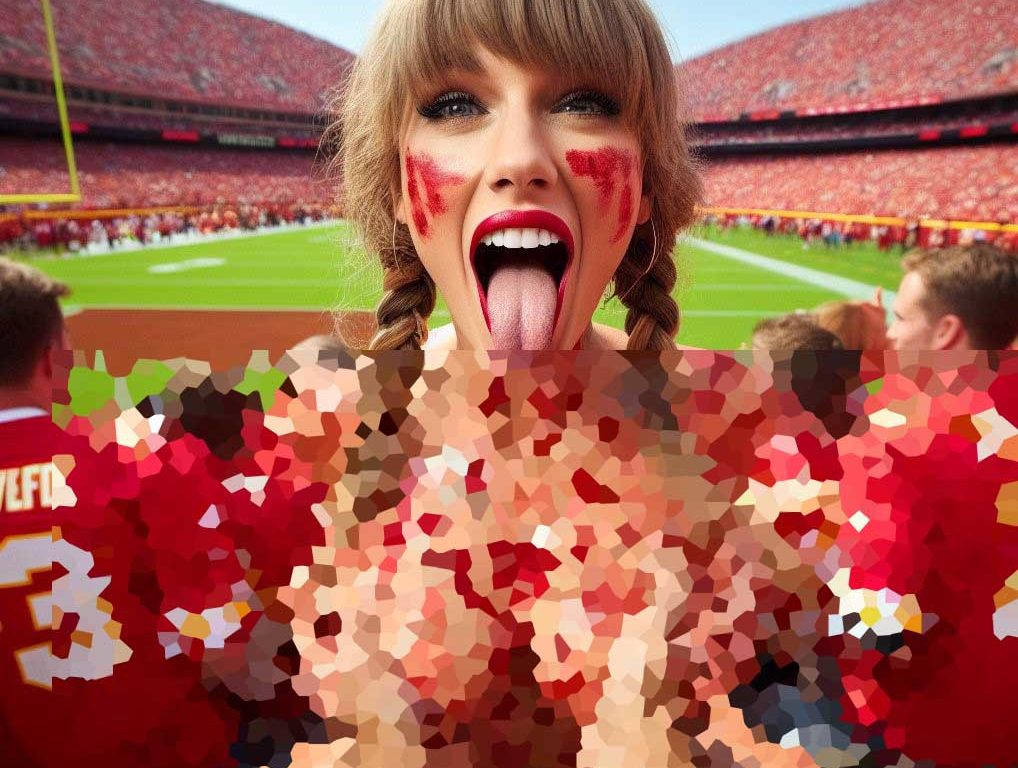

Taylor Swift dépouillée de l'IA est devenue le sujet viral de ces dernières heures. De fausses images pornographiques de Taylor Swift générées grâce à l'intelligence artificielle circulent sur les réseaux sociaux. Des images qui ont incité les Swifties, ses fans les plus fidèles, à réclamer désormais une régulation par l'IA de la création non consensuelle d'images classées R. Les images en question – connues sous le nom de « deepfakes » – montrent Swift dans diverses positions lors d'un match des Chiefs de Kansas City, une référence claire au petit ami Travis Kelce qui joue dans cette équipe.

LIRE AUSSI

- Selena Gomez révèle ce qu'elle a laissé échapper à l'oreille de Taylor Swift aux Globes

- Taylor Swift teasée par l'animateur aux Golden Globes : carrière terminée pour lui

- Taylor Swift dans le rôle de « Barbie » : talon cassé et elle reste sur la pointe des pieds

Taylor Swift dépouillée de l'IA

Il n'était pas immédiatement clair qui avait créé les images ou qui les avait partagées en premier sur X, même si "Taylor Swift AI" était à la mode sur la plateforme jeudi matin, avec des milliers de publications sur le sujet. Les Swifties se sont alors regroupés et ont tenté d'enterrer les images en partageant un afflux de messages positifs sur le chanteur de 34 ans. Faisant ainsi disparaître les images contestées dans les profondeurs du web.

C'est aussi de la violence sexuelle

« Comment se fait-il que cela ne soit pas considéré comme une agression sexuelle ? » a demandé à l'utilisateur «Quand j'ai vu les photos IA de Taylor Swift, je n'en croyais pas mes yeux. Ces images d’IA sont dégoûtantes », a déclaré un autre. D’autres fans scandaleux de Swift ont qualifié celui qui a créé le « dégoûtant » et des cas comme ceux-ci de « ruiner la technologie [IA] ».

Les États-Unis bougent : nous avons besoin d’une loi

Le publiciste de Swift, Tree Paine, n'a pas immédiatement répondu aux questions posées par les médias. Mais le sujet du deepfake est un sujet brûlant sur l’agenda politique américain. Le président Joe Biden a signé un décret en octobre pour réglementer davantage l’IA qui empêche « l’intelligence artificielle générative de produire de la pédopornographie ou des images intimes non consensuelles d’individus réels ». L’ordonnance exige également que le gouvernement fédéral publie des lignes directrices « pour le filigrane ou l’étiquetage des résultats de l’intelligence artificielle générative ».

La pornographie deepfake non consensuelle a également été rendue illégale au Texas, au Minnesota, à New York, à Hawaï et en Géorgie, bien qu'elle n'ait pas réussi à arrêter la circulation d'images de nus générées par l'IA dans les lycées du New Jersey et de Floride, où des images deepfakes explicites d'étudiantes. ont été propagées par des camarades de classe masculins.

LIRE LES AUTRES NOUVELLES DU MONDE

- Un hôtel de Floride fait sensation : un homme arrêté pour exhibitionnisme avec un aspirateur

- Un père ivre pend son fils par la fenêtre : vidéo choquante

- Une enseignante admet être tombée enceinte d'un élève de 13 ans

- Un élève tente de poignarder son camarade, le professeur le sauve à coups de chaise.

- L'étrange ecchymose de Trump à Davos : voici de quoi il s'agit

Suivez-nous également sur Google News : Cliquez ici