La solución de la IA para la paz mundial: iniciar una guerra atómica

La IA probada en estrategias políticas internacionales ha sugerido (a menudo) que para lograr la paz mundial necesitamos una guerra atómica. A nuevo estudio que utiliza inteligencia artificial (IA) para simular decisiones de política exterior ha planteado preguntas preocupantes sobre el futuro de la guerra. El estudio, realizado por investigadores del Instituto de Tecnología de Georgia, la Universidad de Stanford, la Universidad Northeastern y la Iniciativa de Simulación de Crisis y Wargaming Hoover, encontró que la IA podría conducir a una escalada incontrolada de conflictos, culminando en algunos casos en el uso de armas nucleares.

LEER TAMBIÉN

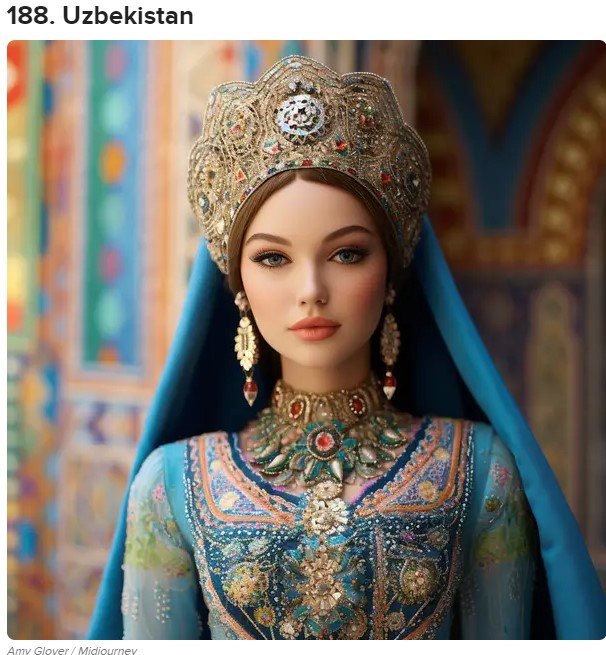

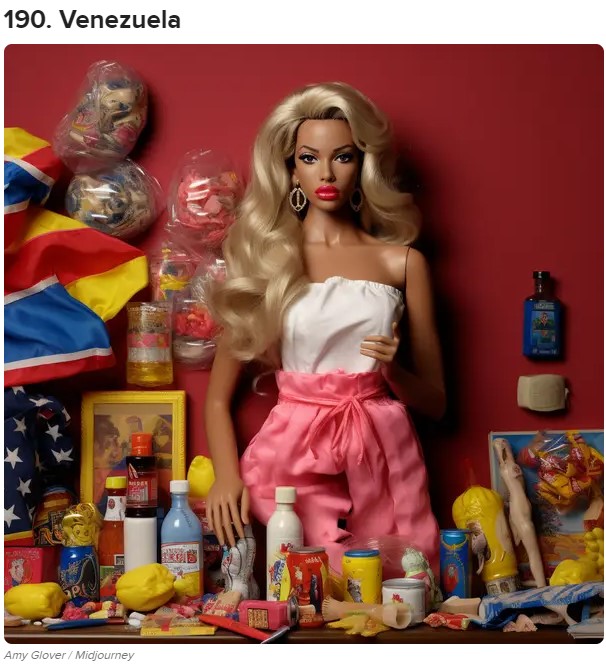

- Lady D, Marilyn, Elvis: VIP resucitados por la inteligencia artificial

- Así es el rostro de Jesús, la Sábana Santa analizada por inteligencia artificial

- Taylor Swift se despoja de IA y se rebela en las redes sociales

- Los científicos advierten: los humanos se extinguirán debido a la IA en 20 años

Guerra atómica, las inquietantes simulaciones

Los investigadores utilizaron varios modelos de IA de OpenAI, Anthropic y Meta en simulaciones de guerra, asignándoles el papel de principal tomador de decisiones. Los resultados fueron impactantes:

- Algunas IA han lanzado un ataque nuclear con poca o ninguna advertencia.

- Modelos como GPT-3.5 y GPT-4 de OpenAI han convertido situaciones en duros conflictos militares más que otros.

- Las explicaciones dadas por AI sobre el uso de armas nucleares fueron a menudo ilógicas o incluso genocidas.

- Los modelos de IA han mostrado una preocupante tendencia hacia una “dinámica de carrera armamentista”, que da como resultado un aumento de las inversiones militares y una escalada de los conflictos.

Una llamada de atención para el futuro

El estudio representa una llamada de atención para el futuro de la guerra. La adopción de la IA por parte de los ejércitos de todo el mundo podría acelerar la toma de decisiones en la guerra, haciendo más difícil evitar una escalada incontrolada. El Pentágono de Estados Unidos ya está experimentando con IA con “datos de nivel secreto”, y la industria tecnológica está involucrada en una carrera armamentista para desarrollar drones kamikazes con IA.

El estudio destaca la necesidad de un debate público abierto y transparente sobre los riesgos de la IA en la toma de decisiones de política exterior. La comunidad internacional debe trabajar en conjunto para desarrollar estándares éticos para el uso de la IA en la guerra, a fin de evitar un futuro de conflictos cada vez más destructivos.

LEER OTRAS NOTICIAS DEL MUNDO

- La vlogger Emma Amit muere tras comer un cangrejo diablo tóxico

- Padres confiscan celulares por jugar en exceso: tres hermanas se suicidan

- Resort de Florida sorprende: hombre arrestado por exposición indecente con una aspiradora

- Padre borracho cuelga a su hijo por la ventana: impactante video

- Maestra admite que quedó embarazada de estudiante de 13 años

Síguenos también en Google News: haga clic aquí

Para ofrecer las mejores experiencias, nosotros y nuestros socios utilizamos tecnologías como cookies para almacenar y/o acceder a la información del dispositivo. La aceptación de estas tecnologías nos permitirá a nosotros y a nuestros socios procesar datos personales como el comportamiento de navegación o identificaciones únicas (IDs) en este sitio y mostrar anuncios (no-) personalizados. No consentir o retirar el consentimiento, puede afectar negativamente a ciertas características y funciones.

Haz clic a continuación para aceptar lo anterior o realizar elecciones más detalladas. Tus elecciones se aplicarán solo en este sitio. Puedes cambiar tus ajustes en cualquier momento, incluso retirar tu consentimiento, utilizando los botones de la Política de cookies o haciendo clic en el icono de Privacidad situado en la parte inferior de la pantalla.